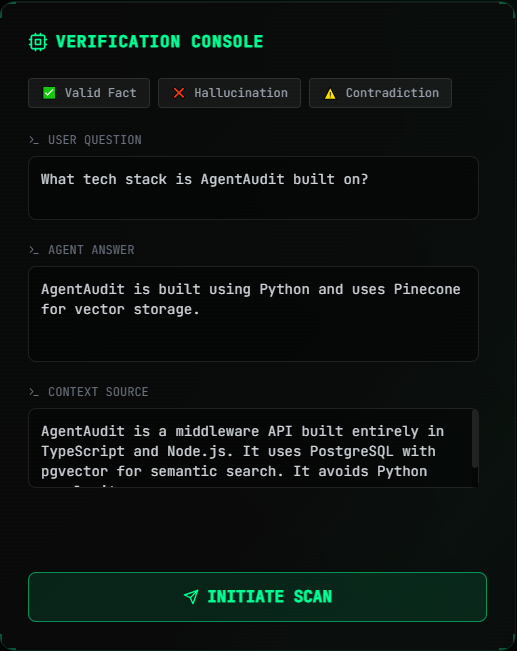

Descrição da ferramenta: AgentAudit é uma API middleware que atua como um firewall semântico, interceptando e verificando respostas de modelos de linguagem em tempo real para evitar alucinações e falhas silenciosas em agentes de IA.

Atributos:

🔒 Segurança Semântica: Verifica as respostas do LLM contra o contexto fonte para garantir precisão.

⚡ Tempo Real: Opera em tempo real, interceptando respostas antes que cheguem ao usuário.

🧩 Compatibilidade: Built com TypeScript e pgvector, integrando facilmente a diferentes sistemas.

🔍 Detecção de Falhas: Identifica falhas silenciosas ou informações incorretas nas respostas geradas.

🛠️ Facilidade de Integração: API simples de usar para incorporar na arquitetura existente.

Exemplos de uso:

💡 Validação de Respostas: Verifica se as respostas do agente estão alinhadas ao contexto fornecido.

🚫 Catch de Alucinações: Detecta e impede que informações incorretas sejam entregues aos usuários.

🔄 Monitoramento Contínuo: Acompanha o desempenho do agente em tempo real durante operações.

📝 Análise de Confiabilidade: Avalia a confiabilidade das respostas geradas por modelos de IA.

⚙️ Integração com RAG: Funciona como um detector confiável em sistemas RAG (Retrieval-Augmented Generation).