Descrição da ferramenta: imgcmd é uma interface de linha de comando segura que gera arquivos PNG reais diretamente no disco, utilizando a tecnologia Gemini. Compatível com Cursor e VS Code, garante privacidade e controle na geração de imagens.

Atributos:

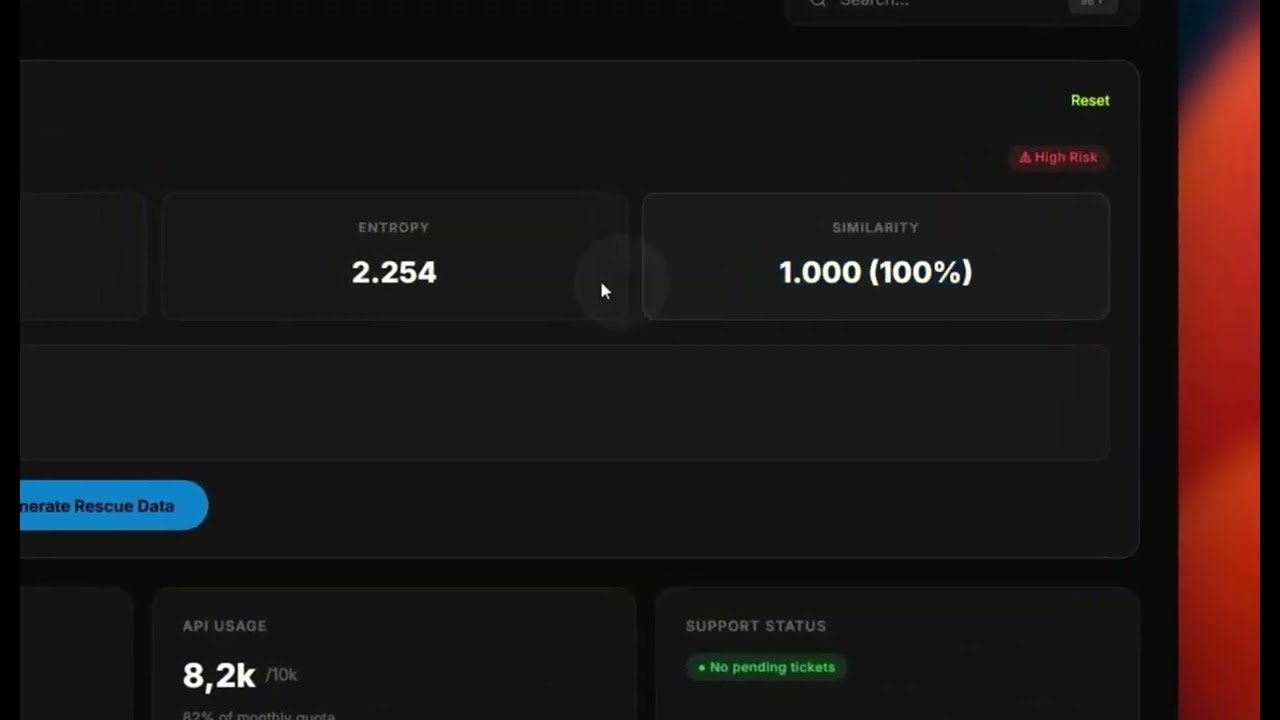

🛡️ Segurança: Protege chaves API e mantém o controle do uso, evitando gastos indevidos com IA.

⚙️ Integração: Compatível com Cursor e VS Code para uso nativo em ambientes de desenvolvimento.

💾 Geração direta: Cria arquivos PNG reais diretamente no disco, eliminando problemas de SVGs incorretos ou inválidos.

🔒 Governança: Permite impor políticas de uso e evitar ações não autorizadas na geração de imagens.

🚀 Desempenho: Processo eficiente para gerar imagens rapidamente sem intermediários desnecessários.

Exemplos de uso:

🖼️ Criando imagens estáticas: Gerar PNGs precisos para inclusão em relatórios ou apresentações.

🔧 Aprimoramento de workflows: Integrar imgcmd ao VS Code para automatizar a geração de imagens durante o desenvolvimento.

🔐 Controle de custos: Utilizar API keys localmente para evitar gastos inesperados com agentes AI não autorizados.

📁 Preservação de arquivos: Salvar imagens geradas diretamente no disco para armazenamento seguro e acessível.

🛠️ Solução para SVGs problemáticos: Substituir SVGs quebrados por PNGs confiáveis gerados pelo imgcmd.