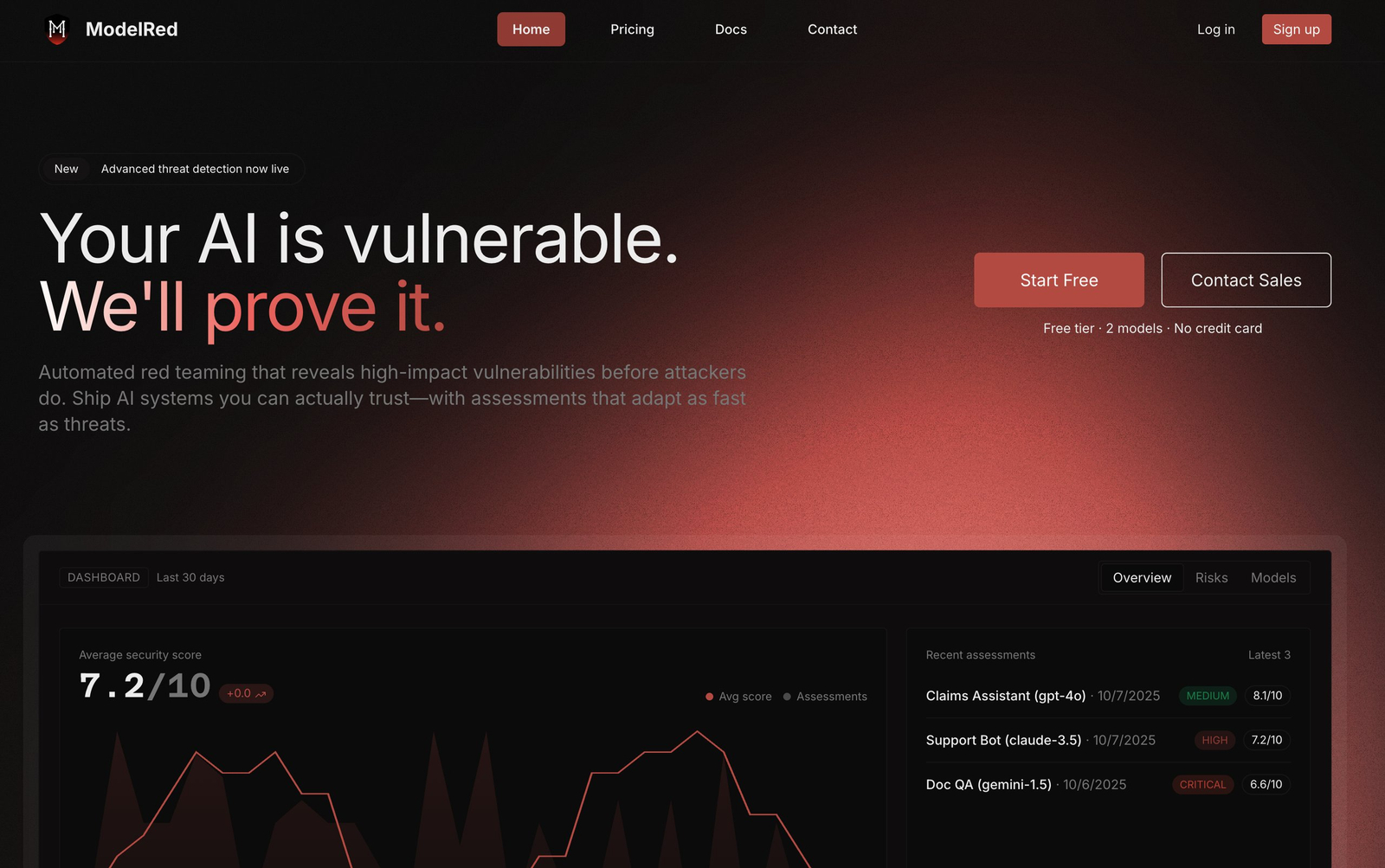

Descrição da ferramenta: BotGuard é uma plataforma de segurança automatizada para agentes de inteligência artificial, detectando e corrigindo vulnerabilidades como injeções de prompt, jailbreaks e vazamentos de dados em tempo real, garantindo proteção contínua durante o desenvolvimento e implantação.

Atributos:

🛡️ Proteção em Tempo Real: Monitora continuamente os agentes de IA, identificando ameaças assim que ocorrem.

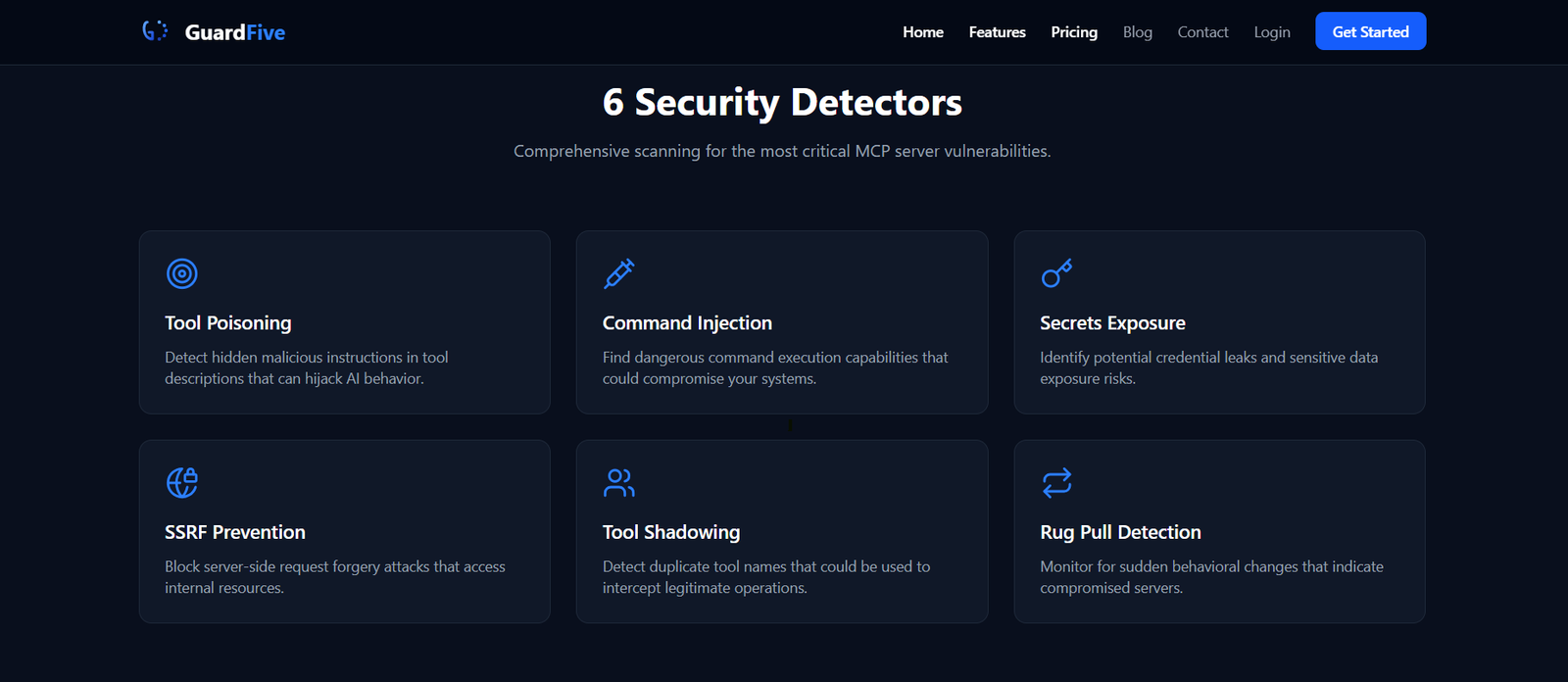

🔍 Análise de Vulnerabilidades: Detecta tentativas de injeções de prompt, jailbreaks e vazamentos de dados nos agentes.

🤖 Auto-correção com IA: Corrige automaticamente vulnerabilidades detectadas usando inteligência artificial avançada.

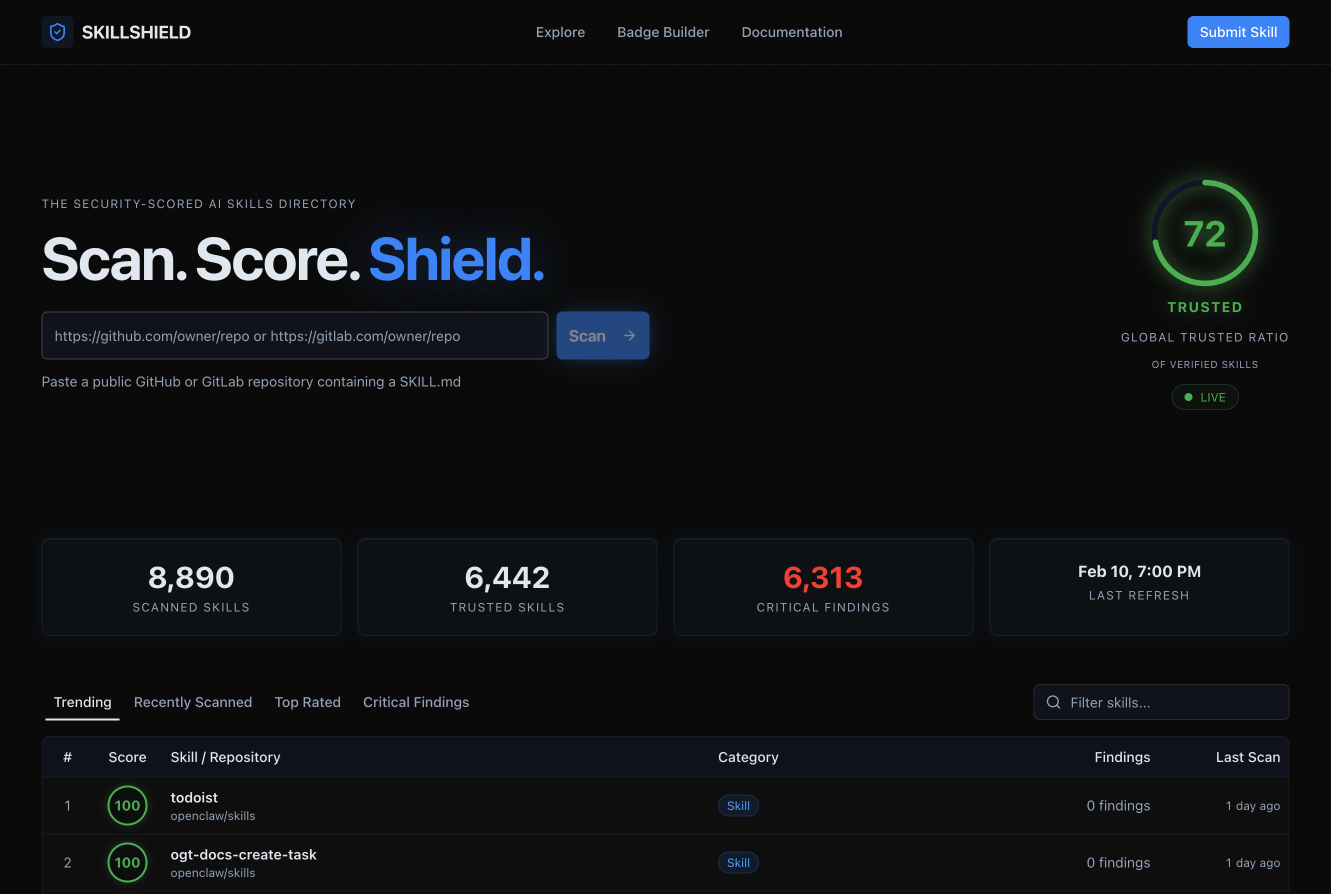

✅ Certificação de Segurança: Oferece certificações que atestam a conformidade dos agentes com padrões de segurança.

🚧 Firewall Integrado: Protege os agentes contra ataques externos durante toda a operação.

Exemplos de uso:

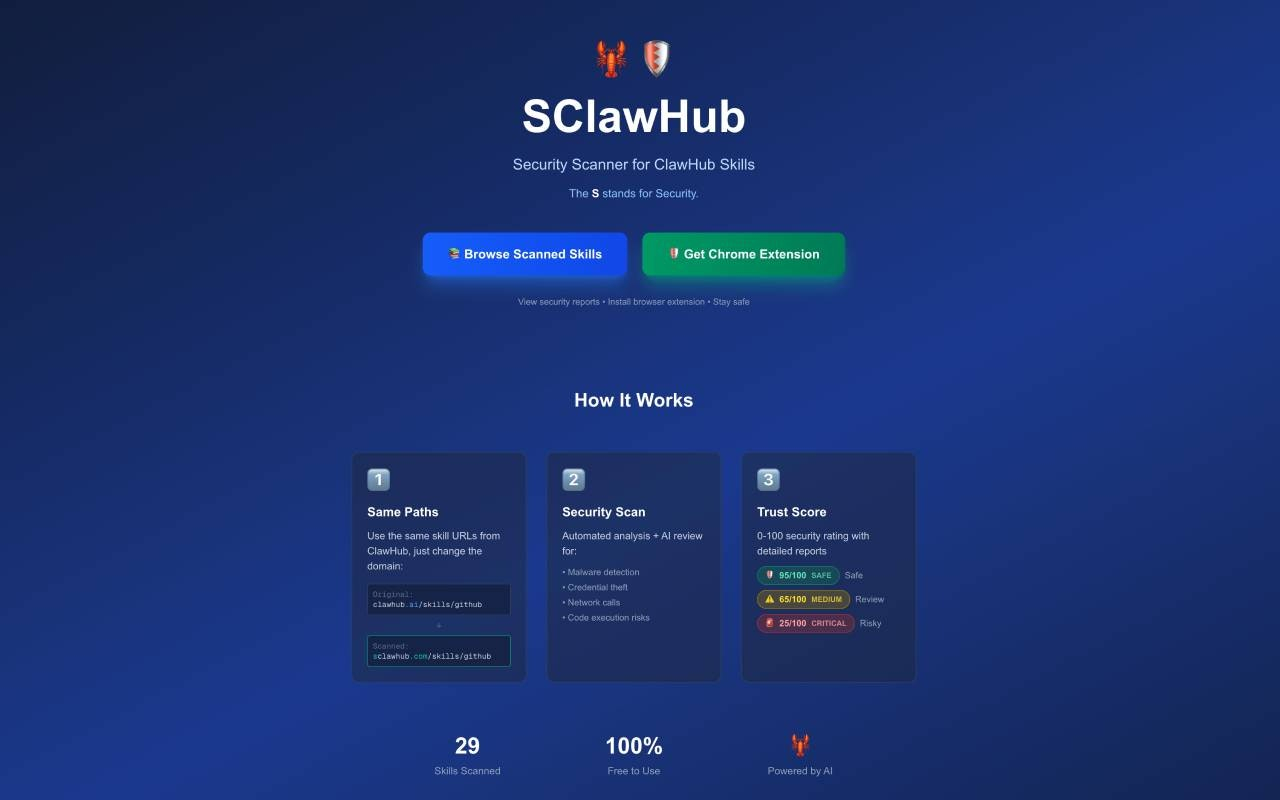

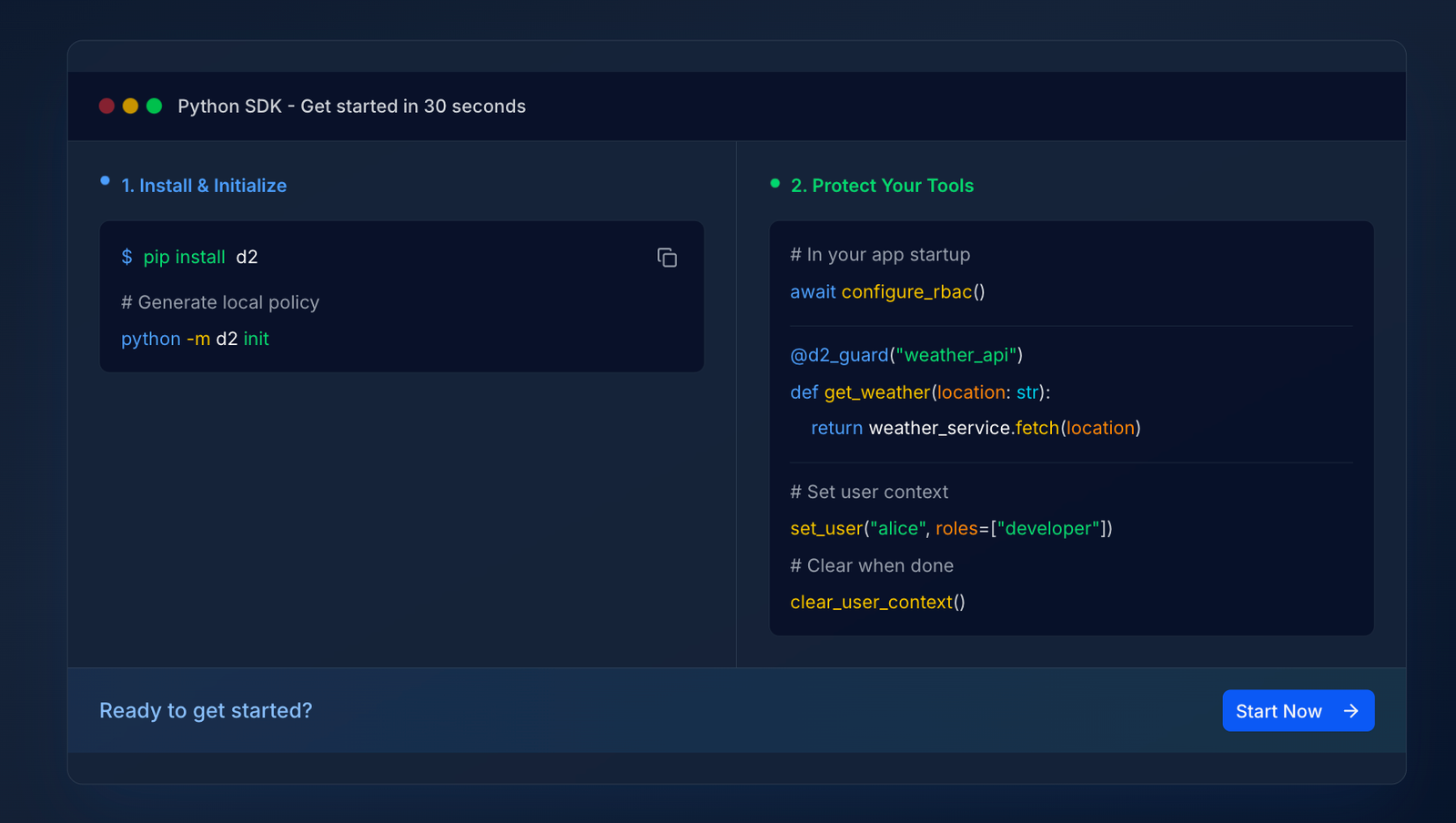

📝 Validação pré-implantação: Escaneia agentes AI antes do lançamento para identificar possíveis vulnerabilidades.

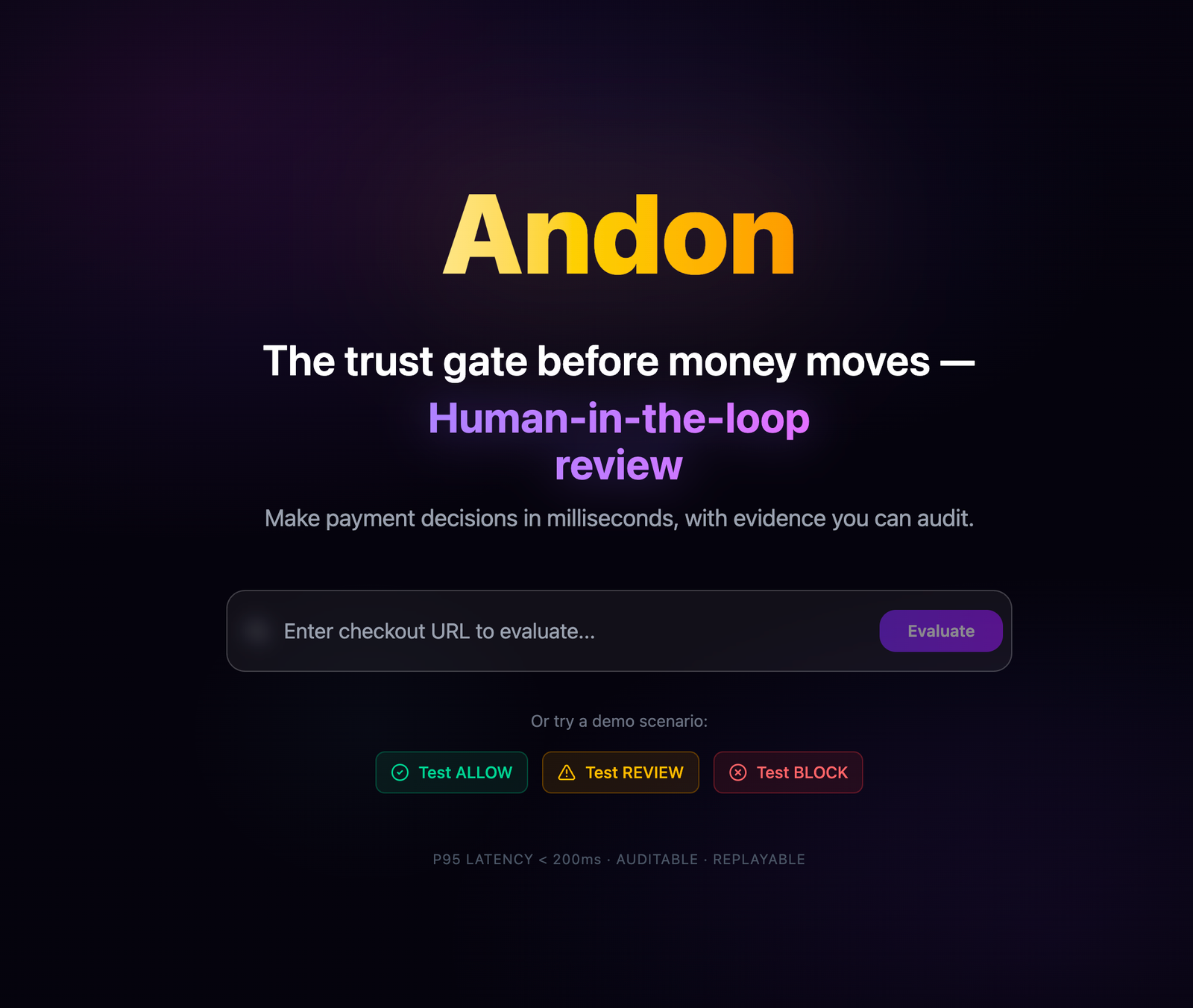

🔒 Proteção contínua durante execução: Monitora chatbots em tempo real para evitar vazamentos ou manipulações maliciosas.

⚙️ Ajuste automático de segurança: Corrige automaticamente falhas detectadas sem intervenção manual.

🛠️ Avaliação de segurança para desenvolvedores: Fornece relatórios detalhados sobre pontos fracos nos agentes AI.

🌐 Cumprimento normativo: Auxilia empresas a manterem seus sistemas alinhados às exigências de segurança do setor.