Descrição da ferramenta: Guardio é um proxy intermediário que monitora e controla as mensagens entre sistemas de agentes de IA e recursos externos, permitindo a aplicação de políticas, aprovação de ações e observação do tráfego via sistema de plugins.

Atributos:

🔒 Segurança: Protege o sistema ao filtrar e sanitizar mensagens antes que cheguem aos servidores externos.

⚙️ Configuração Flexível: Permite definir políticas específicas para permitir, bloquear ou modificar comunicações.

🛡️ Controle de Acesso: Impõe regras de autorização para interações com APIs e ferramentas externas.

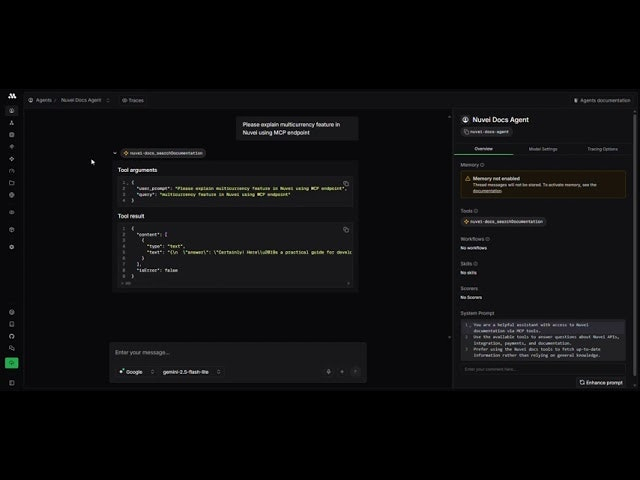

👁️ Monitoramento: Observa o fluxo de mensagens em tempo real, facilitando auditorias e análises.

🔌 Integração via Plugins: Sistema extensível que suporta plugins para personalizar funcionalidades.

Exemplos de uso:

📝 Avaliação de mensagens: Verifica o conteúdo das mensagens trocadas entre agentes e APIs externas para garantir conformidade.

🚫 Bloqueio de comandos não autorizados: Impede que comandos específicos sejam enviados às ferramentas externas sem permissão prévia.

🧹 Saneamento de dados: Sanitiza informações sensíveis antes do envio para proteger a privacidade dos usuários.

✅ Aprovação manual: Requer aprovação humana antes que certas ações sejam executadas por agentes automatizados.

🔍 Análise de atividades: Monitora atividades suspeitas ou anômalas na comunicação entre agentes e recursos externos.