Descrição da ferramenta: Oratrixa Phronosis é uma plataforma de comunicação que utiliza inteligência artificial determinística para propor ações, promovendo segurança emocional e alinhamento profundo por meio de um protocolo de governança distribuída entre agentes.

Atributos:

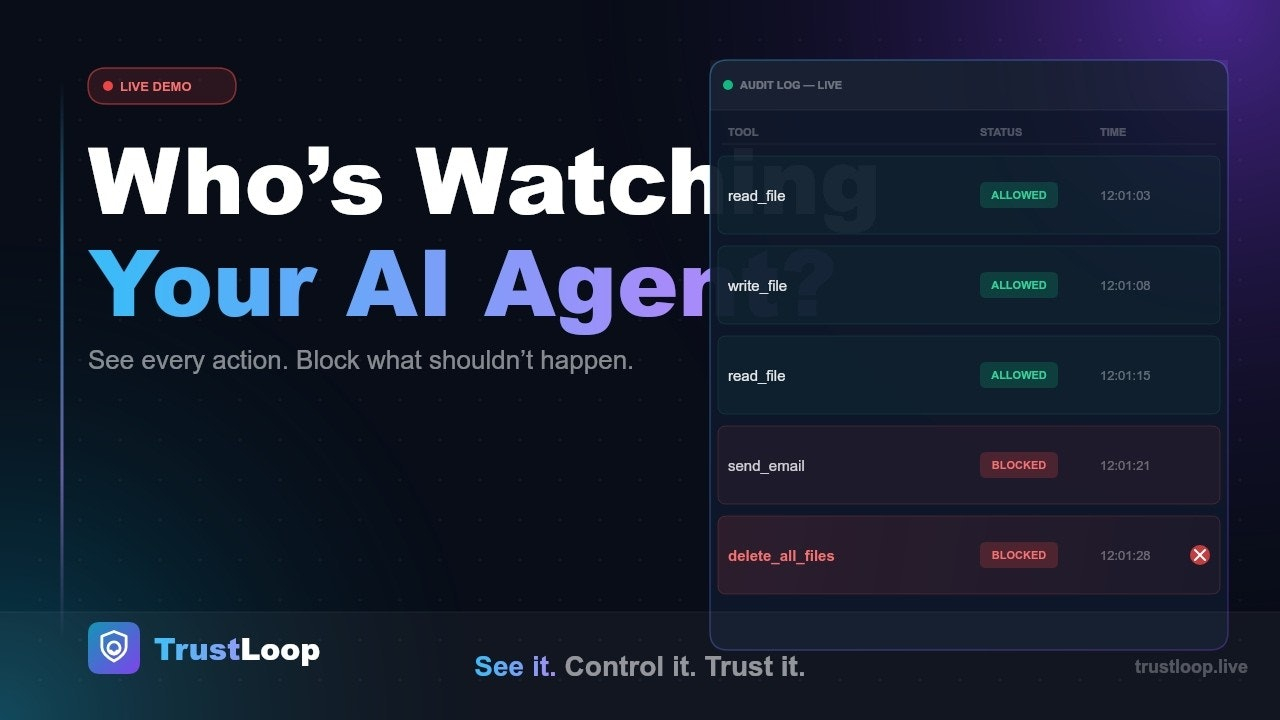

🧠 Inteligência Artificial: Utiliza IA avançada para otimizar propostas e decisões, garantindo precisão e confiabilidade.

🔒 Sistema de Segurança Emocional: Cria um ambiente de comunicação seguro, promovendo confiança e alinhamento emocional.

⚖️ Governança Distribuída: Implementa um protocolo descentralizado onde a decisão final é tomada por consenso, não pelos agentes isoladamente.

📊 Mecanismo de Avaliação Determinística: Avalia cada proposta com base em cálculos matemáticos rigorosos antes da execução.

🌐 Grafos de Confiança: Constrói uma rede que acumula confiança ao longo do tempo, fortalecendo a relação entre agentes e usuários.

Exemplos de uso:

💬 Análise de Comunicação Corporativa: Facilita diálogos internos ao propor ações alinhadas às metas organizacionais.

🤝 Mediador em Negociações: Atua como intermediário propondo soluções baseadas em dados confiáveis durante negociações complexas.

🛡️ Sistema de Segurança Emocional: Mantém ambientes seguros em plataformas colaborativas, prevenindo conflitos emocionais.

📈 Aprimoramento na Tomada de Decisão: Oferece recomendações fundamentadas para decisões estratégicas empresariais ou institucionais.

🌍 Gestão Descentralizada: Facilita a governança distribuída em projetos colaborativos ou comunidades virtuais.