Descrição da ferramenta: TextCompressor é um proxy que comprime prompts de linguagem natural, removendo palavras desnecessárias e mantendo o significado, otimizando o uso de tokens e reduzindo custos em APIs de modelos de linguagem compatíveis.

Atributos:

🛠️ Compatibilidade: Funciona com OpenAI, Anthropic, Ollama, LM Studio e outros modelos compatíveis.

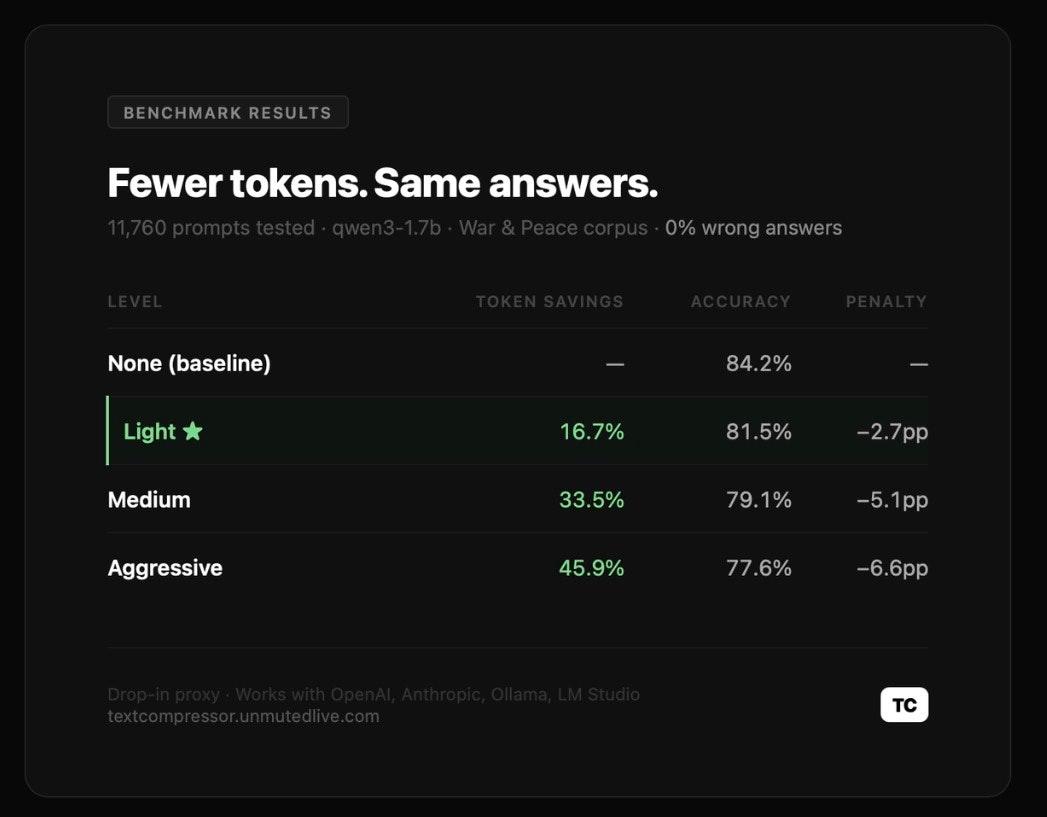

⚡ Redução de tokens: Diminui o número de tokens utilizados nas requisições, variando entre 16.7% a 45.9% dependendo do modo.

🔧 Sem uso de IA na compressão: Opera exclusivamente via CPU, sem utilizar inteligência artificial na otimização.

🔒 Fácil integração: Basta apontar seu cliente OpenAI para a API do proxy e adicionar um cabeçalho para ativar a compressão.

📉 Economia de custos: Reduz significativamente os gastos com APIs ao diminuir o volume de tokens processados.

Exemplos de uso:

💻 Ponto de integração: Configurar o proxy em aplicações que utilizam APIs de modelos de linguagem para otimizar custos automaticamente.

📊 Análise de eficiência: Testar diferentes níveis (Light, Medium, Aggressive) para balancear economia e precisão conforme necessidade.

🔄 Ajuste dinâmico: Alterar configurações do modo para adaptar a compressão às mudanças no fluxo de trabalho ou orçamento.

📝 Simplificação de prompts: Remover palavras redundantes antes do envio ao modelo para melhorar desempenho e reduzir custos.

⚙️ Implementação em pipelines existentes: Integrar facilmente sem modificar o código original dos clientes que usam APIs compatíveis.