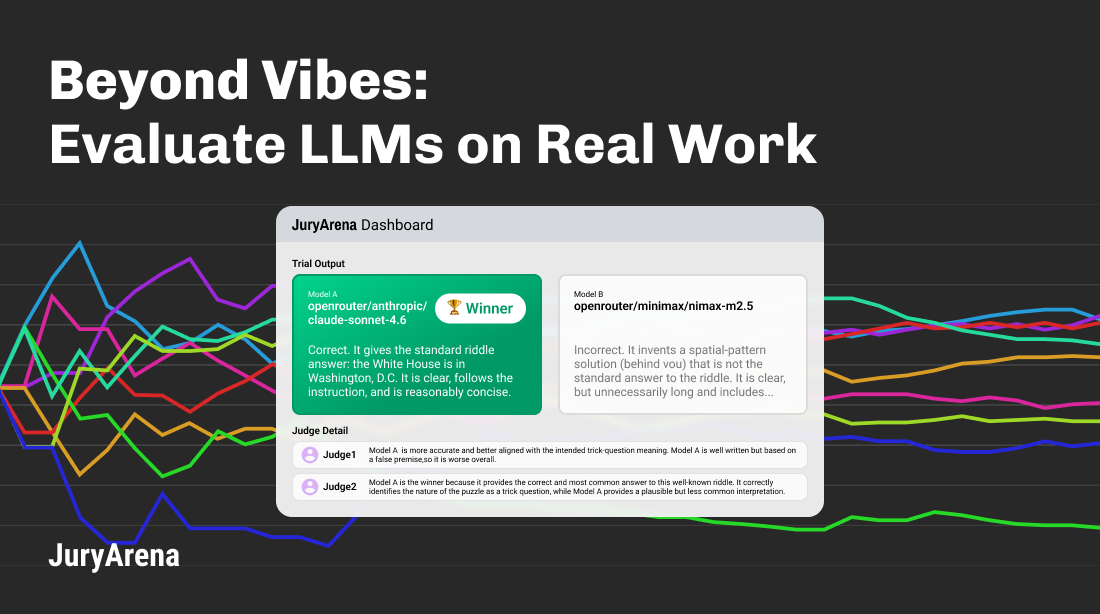

Descrição da ferramenta: JuryArena é uma plataforma open source que realiza testes comparativos entre modelos de linguagem, permitindo avaliar desempenho em prompts reais por meio de um júri de IA, sem necessidade de ground truth, facilitando a escolha do LLM ideal para produção.

Atributos:

🧪 Testes comparativos: Executa disputas entre diferentes modelos de linguagem para determinar o melhor desempenho.

🤖 Júri de IA: Utiliza uma inteligência artificial especializada para avaliar e decidir o vencedor das disputas.

🔍 Rastreamento detalhado: Armazena todos os resultados das avaliações como registros acessíveis para análise futura.

🔓 Código aberto e auto-hospedável: Disponível para instalação local, garantindo controle total sobre os dados e configurações.

⚙️ Sem necessidade de ground truth: Avaliações baseadas em critérios internos, sem dependência de respostas corretas pré-definidas.

Exemplos de uso:

📝 Avaliação de modelos em prompts específicos: Testar diferentes LLMs com prompts customizados para verificar qual oferece melhores respostas.

📊 Análise comparativa contínua: Monitorar o desempenho dos modelos ao longo do tempo em tarefas recorrentes.

🔧 Integração em pipelines de produção: Incorporar as disputas na rotina de validação antes da implementação final dos modelos.

💡 Identificação do modelo mais adequado: Selecionar automaticamente o LLM que melhor atende às necessidades específicas do projeto.

🛠️ Ajuste e calibração de modelos: Usar os resultados das disputas para orientar melhorias nos modelos utilizados.