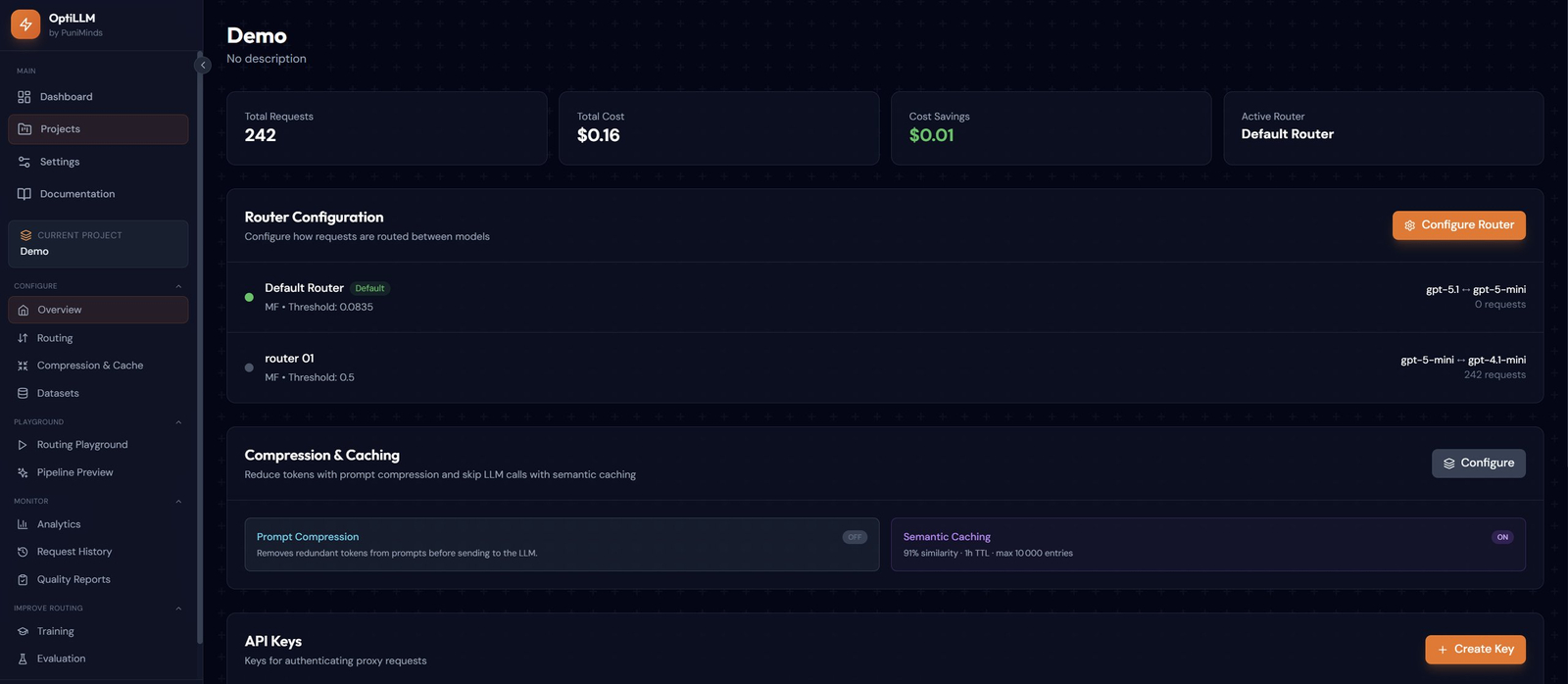

Descrição da ferramenta: OptiLLM é uma plataforma que reduz custos de APIs de modelos de linguagem, otimizando o uso por meio de roteamento inteligente, compressão de tokens e cache de consultas sem necessidade de alterações no código.

Atributos:

🔍 Classificação ML: Utiliza algoritmos de aprendizado de máquina para identificar o modelo mais econômico capaz para cada prompt.

🗂️ Cache Semântico: Armazena consultas similares usando busca vetorial com FAISS, acelerando respostas e economizando recursos.

📉 Redução de Custos: Diminui os gastos com APIs em até 50% ou mais, mantendo a qualidade das respostas.

⚙️ Compatibilidade OpenAI: Funciona como um proxy compatível com OpenAI, sem necessidade de mudanças no código existente.

📊 Análise e Avaliação: Disponibiliza dashboards e ferramentas para monitorar desempenho e otimizar continuamente os custos.

Exemplos de uso:

💡 Otimização de custos em chatbots: Reduz despesas operacionais ao gerenciar múltiplas requisições com eficiência.

🔧 Ajuste dinâmico do roteamento: Treina modelos personalizados para melhorar a relação custo-benefício na entrega das respostas.

🚀 Padrões de consulta semelhantes: Usa cache semântico para acelerar respostas a perguntas recorrentes ou similares.

📈 Análise de desempenho: Monitora métricas via dashboards para identificar oportunidades de economia adicional.

🛠️ Integração fácil: Implementa como proxy compatível com OpenAI, dispensando alterações complexas na infraestrutura existente.