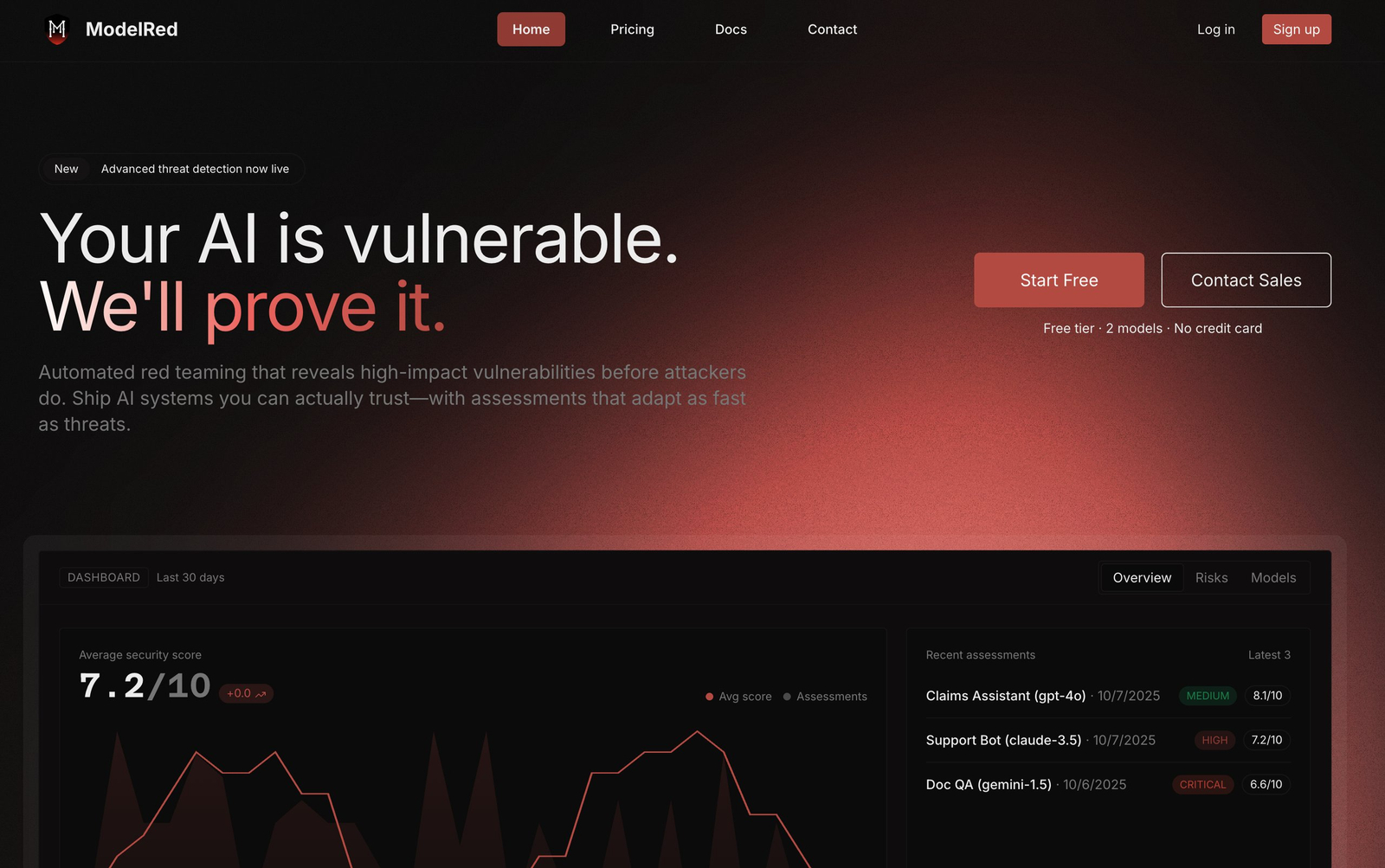

Descrição da ferramenta: ModelRed é uma plataforma que identifica vulnerabilidades em modelos de IA, realizando mais de 200 testes adaptativos em diversos vetores de ataque, garantindo a segurança do seu modelo antes que hackers possam explorá-lo.

Atributos:

🛡️ Detecção Proativa: Identifica vulnerabilidades antes que sejam exploradas por atacantes.

⚙️ Testes Adaptativos: Executa mais de 200 probes dinâmicos ajustados ao contexto do modelo.

🌐 Compatibilidade Ampla: Funciona com diversos provedores e plataformas, como OpenAI, Anthropic, Azure, AWS e HuggingFace.

📊 Pontuação de Segurança: Fornece o ModelRed Score para avaliar a robustez do seu modelo de IA.

🔒 Segurança Acelerada: Permite a implementação rápida de melhorias na segurança do seu sistema de IA.

Exemplos de uso:

🔍 Análise de Vulnerabilidades: Avaliar modelos de linguagem para identificar pontos fracos antes do deployment.

🛠️ Aprimoramento de Segurança: Utilizar os resultados dos testes para reforçar as defesas do modelo.

🚀 Lançamento Seguro: Garantir que o modelo esteja protegido contra ataques durante o lançamento no mercado.

📈 Avaliação Contínua: Monitorar constantemente a segurança do modelo após sua implantação.

🤖 Teste em Diversas Plataformas: Validar a resistência do modelo em diferentes ambientes e provedores cloud.